[천지일보 공주=박주환 기자] 최대선 공주대학교 교수는 얼굴에 몇 개의 점을 붙여 얼굴인식 AI가 다른 사람으로 인식하게 만드는 데 성공했다고 15일 밝혔다.

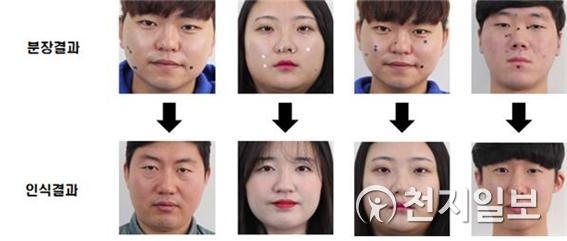

연구팀이 개발한 공격자 AI에 얼굴 사진을 입력하면 얼굴에 붙일 점의 위치를 알려준다. 공격자 AI가 알려준 대로 얼굴에 점 스티커를 붙이면 얼굴인식 AI는 전혀 다른 사람으로 인식하게 된다.

이번 연구는 이미지 상태가 아닌 실제 얼굴에 약간의 분장을 통해 얼굴인식 AI를 기만할 수 있다는 것을 보여준 세계 최초 연구다.

해외에서 표지판에 스티커를 붙여 오인식하게 만드는 연구가 소개된 바 있지만 얼굴 분장을 통한 얼굴인식 AI를 기만하는 사례는 이번 공주대 연구가 최초다.

연구팀을 이끈 최대선 교수는 “이러한 기만 공격 이외에도 AI의 오동작을 유발하거나, 학습에 사용된 데이터를 추출하여 프라이버시를 침해하는 등 여러가지 AI 보안 취약점이 알려져 있다”며 “최근 AI에 대한 국가적 관심과 산업계의 적용이 활발한 가운데 AI 보안 문제에 대해서도 심각성을 인식하고 대비해야 한다”고 말했다.

천지일보는 24시간 여러분의 제보를 기다립니다.

박주환 기자

bumpark31@naver.com

다른 기사 보기